发布日期:2025-03-06 09:12点击次数:

面对生成式 AI 私有场景部署落地在实际应用中存在的诸多局限。例如:

单机算力受限:单机资源不足,却无法多机分布式运行大参数量的模型

并发吞吐受限:部署方案难以支持生产级的高并发、大规模推理

国产适配难题:无法在国产芯片上运行

这些挑战让用户在 AI 模型部署过程中投入大量时间精力,但最终可能仍然难以找到理想的国产化私有部署方案。

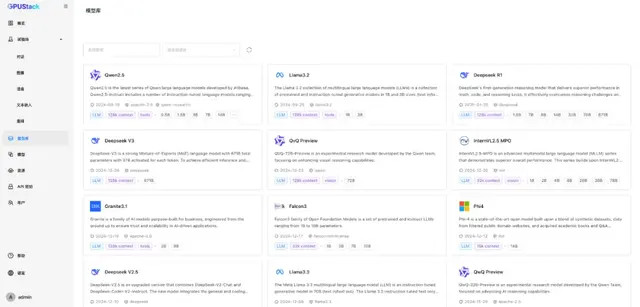

针对这些困扰已久的难题,数澈软件联合 DCU,基于 100% 开源的私有模型服务平台 GPUStack 联合发布了 AI 模型私有部署的高效国产化解决方案,让各种 AI 模型在各种多机环境下都能实现一键部署。在近期发布的版本中,GPUStack 完成了与 DCU 的适配工作,支持在 DCU 上部署 Qwen、Llama 等大语言模型和多模态模型、图像生成模型、文本嵌入向量化模型、重排序模型等各种生成式 AI 模型。

GPUStack 还针对企业的重点部署需求进行了支持和优化。例如,支持 DCU 集群的多机分布式推理,运行单机无法承载的模型,突破单机资源限制。对于生产环境部署,GPUStack 提供高并发、高吞吐的推理方案,为生产大规模落地场景提供支撑。

深度利用 DCU 实现高并发、高吞吐、负载均衡的生产部署

在需要高并发、高吞吐、低延迟的生产环境,GPUStack 全面适配 DCU,深度优化了底层架构、资源计算与共享调度算法,使 GPUStack 能够在 DCU 上高效部署推理各种生成式 AI 模型,充分利用各种多卡并行技术、推理加速技术、多实例负载均衡技术、资源预留技术,稳定地支撑大规模并发请求,在显著降低资源消耗的同时提升推理效率。充分发挥国产硬件的计算能力,实现自主可控的私有化部署方案。

突破单机资源瓶颈,多机分布式推理高效利用 DCU 资源

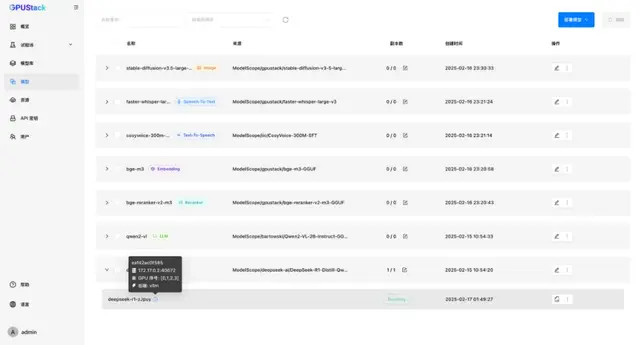

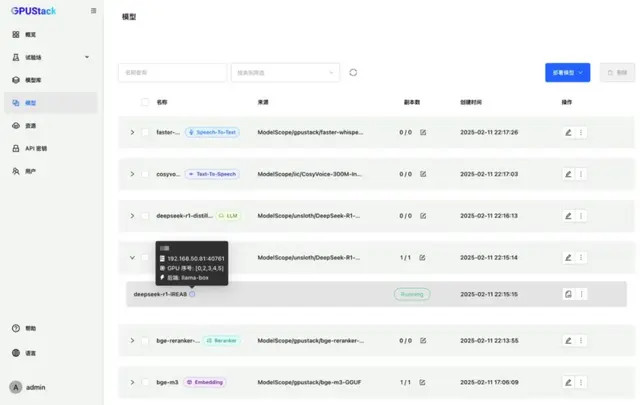

当单台 DCU 服务器无法满足模型运行时,GPUStack 支持多机分布式推理更大参数量的模型。用户可以一键启用 GPUStack 的多机分布式推理能力,通过 UI 配置全自动实现跨多机运行大模型,例如在 8 卡 DCU 服务器上运行 Qwen 2.5 72B 全精度版本,在2 台 8 卡 DCU 服务器上运行更大参数量的模型,突破单机显存限制,高效执行超大规模模型推理。充分发挥国产硬件的计算能力,实现自主可控的私有化部署方案。

对于企业所需的各种国产化部署场景,GPUStack 都能自动根据当前 DCU 环境的资源分布情况,选择最佳的模型部署方案,提供自动化的资源分配和调度部署,用户不需要手动进行繁琐的部署配置,同时用户也仍然拥有自主控制部署的灵活性。

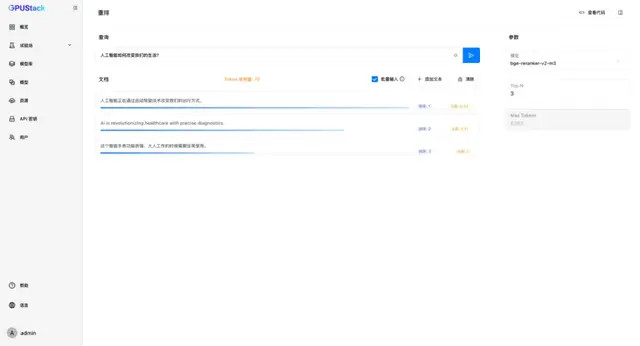

不同的模型、量化方式、上下文大小、推理参数设置或多卡并行配置对显存需求各不相同。GPUStack 提供内置的模型资源测算工具 GGUF Parser来计算的显存需求和资源分布。实际部署时,GPUStack 会自动计算并分配适合的资源,用户不需要操心需要如何分配资源。

生成式 AI 私有化落地:全方位适配 DCU 环境各类生成式 AI 模型部署

除了 大语言模型(LLM),GPUStack 还支持在 DCU 环境部署其他生成式 AI 模型,覆盖更广泛的生成式 AI 私有落地应用场景,包括:

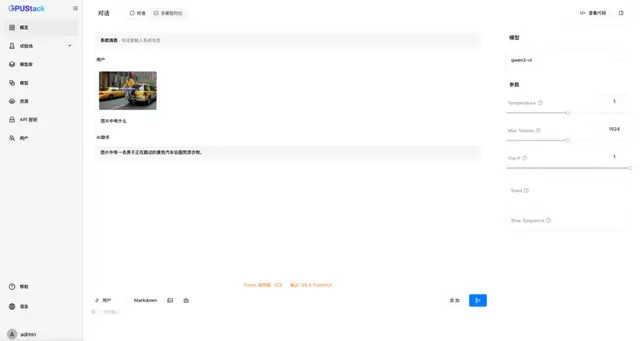

• 支持各类多模态模型,提供多模态图像识别能力,如 Qwen2 VL、InternVL 2.5:

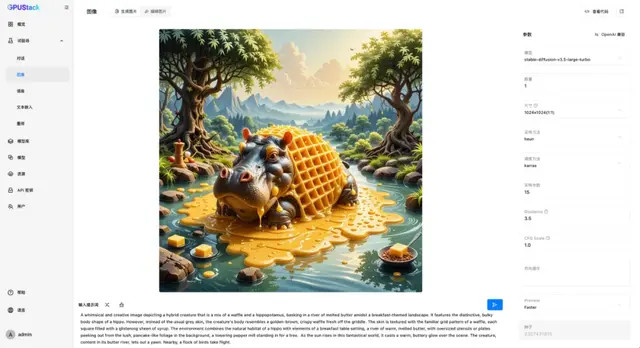

• 支持部署图像生成模型提供文生图、图生图能力,支撑 AI 设计、绘画等场景,如 Stable Diffusion、Flux:

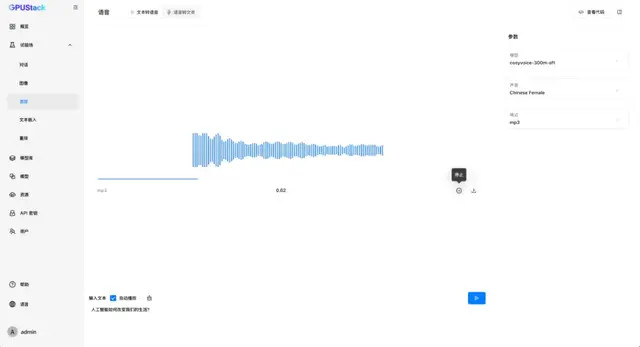

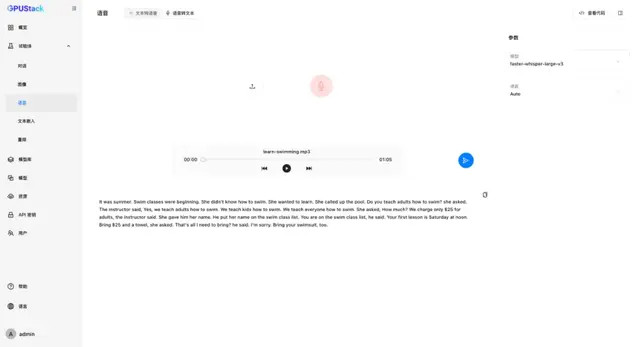

• 支持部署语音模型(STT/TTS)支撑文本转语音和语音转文本应用场景,如 Whisper、CosyVoice:

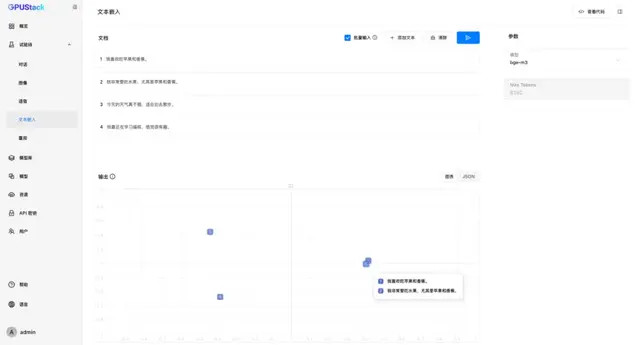

• 支撑 RAG 知识库私有部署落地所需的文本嵌入 Embedding 模型,如 BGE、BCE、Jina:

• 支撑 RAG 知识库私有部署落地所需的 Reranker 模型,如 BGE Reranker、Jina Reranker:

无论是面向 RAG 知识库场景、还是 AI Agents 智能体和其他生成式 AI 落地场景,GPUStack 都能提供 100% 开源的,高效灵活的模型私有部署解决方案,帮助用户轻松运行各类生成式 AI 模型。

完整的私有模型部署、管理与运维国产化解决方案

GPUStack 不仅仅是一个模型推理平台,它具备完整的模型部署、管理与运维解决方案,结合 DCU 强大的算力芯片,让生成式 AI 模型在面对国产化私有部署需求时变得简单与高效,例如:

模型运维管理:应用无感知的模型升级、推理引擎多版本并存的松耦合架构、离线部署场景支持等运维管理能力

高可用推理:为应用提供多实例负载均衡的模型部署,利用多机 DCU 算力,确保稳定、可靠的模型推理服务

监控 & 可视化:提供对 GPU 资源和模型服务的实时观测数据和 Dashboard 仪表板,可视化评估模型服务情况与资源利用情况

安全控制:提供面向团队协作的用户管理、API 认证授权等安全控制能力,更好地满足企业级场景需求

GPUStack 深度整合 DCU,为企业提供低门槛、易上手、开箱即用的开源私有模型服务平台,提供对 Qwen、Llama 等大语言模型、多模态模型、图像生成模型、语音模型(语音转文本/文本转语音)、文本嵌入向量化模型、重排序模型等各种生成式 AI 模型的全面支持,覆盖 RAG 知识库、AI Agents 智能体和其他生成式 AI 落地的私有部署场景。

基于 GPUStack 100% 开源的国产异构 GPU 集群解决方案,帮助企业轻松整合异构算力,灵活分配调度资源,提高异构资源利用率,低成本快速尝试和落地生成式 AI,降低 AI 使用成本。100% 开源的私有化部署能够满足企业数据隐私及安全需求,实现开源开放、数据无忧的 AI 落地与智能化转型。

我们正在快速迭代 GPUStack 项目,如果你对 GPUStack 有任何建议,欢迎提交 GitHub issue。在体验 GPUStack 或提交 issue 之前,请在我们的 GitHub 仓库 gpustack/gpustack 上点亮 Star 关注我们,您的关注是我们的动力源泉。也非常欢迎大家一起参与到这个开源项目中,共同成长!

About GPUStack

GPUStack 是由数澈软件所推出的开源项目。数澈软件成立于2022年,是 Cloud 与 AI Infra 解决方案提供商,目前已完成5300万元种子轮融资。创始团队成员均来自业界应用广泛的 Kubernetes 管理平台 Rancher 的核心团队。其中,联合创始人及 CTO 梁胜博士是前 SUSE 全球工程及创新总裁,加入 SUSE 之前,梁胜博士于2014年9月创立全球著名的容器管理平台公司 Rancher Labs 并担任 CEO。

我们的愿景是赋能企业可以在任意环境使用人工智能以实现业务的卓越运营。GPUStack 是实现这一目标的重要一步。

使用 GPUStack 迅速搭建你的专属 MaaS 平台!开始体验在本地快速构建 GPU 集群,运行和使用各种 AI 模型,并将它们集成到您的应用中。